万博manbext体育官网谷歌的 Gemini 也给与音频输入-万博manbext体育官网(中国大陆)官方网站登录入口

发布日期:2025-01-18 10:47 点击次数:147

从某种意旨上说万博manbext体育官网,2024 年不仅是期间突破的一年,更是行业走向教训的挫折转换点。

这一年,GPT-4 级别的模子不再荒野,许多机构都开发出了性能超越 GPT-4 的模子;这一年,运行效率权贵提高,资本急剧下降;这一年,多模态 LLM,特等是因循图像、音频和视频处理的模子,变得越来越浩繁。

期间的伊始也带来了应用场景的富贵。基于教导词的应用设施生成成为行业标配,语音对话和及时录像头交互让科幻场景成为实验。当年末 OpenAI 推出 o1 系列推理型模子,创始通过优化推理阶段提高性能的新范式时,统统这个词行业又上前迈进了一大步。

当地时辰 12 月 31 日,沉静 AI 接洽员、Django 缔造者、Simon Willison 撰文讲究总结 2024 年大语言模子领域的挫折事件,比肩出了近 20 个关节主题、挫折时刻和行业瞻念察。

以下为要点内容:

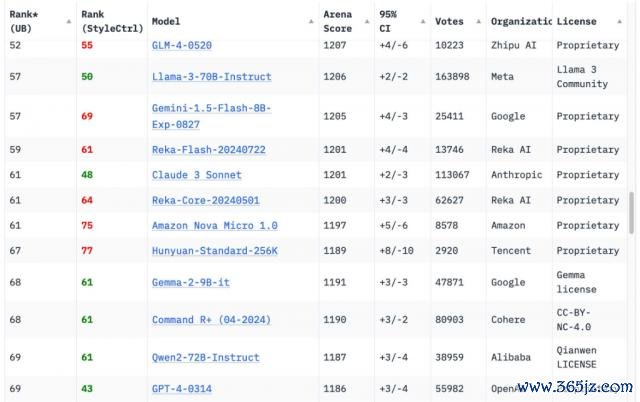

GPT-4 壁垒被全面突破:适度 2024 年底,已有 18 家机构的 70 个模子在 ChatbotArena 排名榜上的得分越过了 2023 年 3 月发布的原始 GPT-4。

顶级大模子的历练资本大幅镌汰:DeepSeek v3 仅需 557 万好意思元历练资本,便可达到与 Claude 3.5 Sonnet 等模子比肩的性能。

LLM 价钱大幅下降:由于竞争加重和效率提高,LLM 的运行资本大幅下降。举例,谷歌的 Gemini1.5Flash8B 比 2023 年的 GPT-3.5Turbo 低廉 27 倍。更低的资本将进一步鼓舞 LLM 的普及和应用。

多模态视觉模子普及,音频和视频模子开动出现:2024 年,险些统统主要的模子供应商都发布了多模态模子,粗略处理图像、音频和视频输入。这使得 LLM 粗略处理更丰富的信息类型,拓展了其应用领域。

语音和及时录像头模式将科幻演义变为实验:ChatGPT 和 GoogleGemini 目下都因循语音和及时录像头模式,用户不错通过语音和视频与模子进行交互。这将为用户提供更当然、更浅易的交互样貌。

部分 GPT-4 级模子可在札记本电脑上运行:收货于模子效率的提高,一些 GPT-4 级模子,举例 Qwen2.5-Coder-32B 和 Meta 的 Llama3.370B,目下不错在 64GB 内存的札记本电脑上运行。这秀丽着 LLM 的硬件条款正在镌汰,为更宽泛的应用场景打开了大门。

基于 Prompt 的应用设施生成已成为常态:LLM 目下不错把柄 Prompt 生成齐备的交互式应用设施,包括 HTML、CSS 和 JavaScript 代码。Anthropic 的 ClaudeArtifacts、GitHubSpark 和 MistralChat 的 Canvas 等用具都提供了这项功能。这一功能极地面简化了应用设施开发经由,为非专科设施员提供了构建应用设施的道路。

对最好模子的浩繁打听只无间了几个月:OpenAI 推出 ChatGPTPro 付费订阅做事,戒指了对最好模子的免费打听。这反应了 LLM 交易模式的演变,畴昔可能会出现更多付费模式。

" Agent "仍未真实收场:" Agent "一词艰苦明确的界说,其效力也受到质疑,因为 LLM 容易轻信造作信息。如何处置 LLM 的真实度问题是收场" Agent "的关节。

评估至关挫折:为 LLM 系统编写考究的自动评估对于构建有用的应用设施至关挫折。有用的评估体系粗略匡助开发者更好地知晓和矫正 LLM。

合成历练数据成果考究:越来越多的 AI 实验室使用合成数据来历练 LLM,这有助于提高模子的性能和效率。合成数据不错克服真实数据的局限性,为 LLM 历练提供更活泼的遴荐。

LLM 的环境影响休戚各半:一方面,模子效率的提高镌汰了单次推理的动力消耗。另一方面,大型科技公司为 LLM 构建基础设施的竞赛导致了大批的数据中心成立,加重了对电力网络和环境的压力。

LLM 使用难度加多:跟着 LLM 功能的不停扩展,其使用难度也在加多。用户需要更深入地了解 LLM 的责任旨趣和局限性,本事更好地专揽其上风。

原文编译如下,祝人人元旦悠闲,enjoy:

GPT-4:从 " 无法企及 " 到 " 浩繁超越 "

在曩昔的一年里,大语言模子 ( LLM ) 领域资格了回山倒海的变化。回望 2023 年底,OpenAI 的 GPT-4 照旧一座难以逾越的岑岭,其他 AI 实验室都在想考统一个问题:OpenAI 究竟掌执了什么独到的期间玄机?

一年后的今天,所在已发生根人性回荡:据 Chatbot Arena 排名榜炫耀 , 原始版块的 GPT-4 ( GPT-4-0314 ) 已跌至第 70 位操纵。目下,已有 18 家机构的 70 个模子在性能上超越了这个也曾的标杆。

谷歌的 Gemini 1.5 Pro 在 2024 年 2 月率先突破,不仅达到 GPT-4 水平,还带来两项紧要立异:它将输入凹凸文长度提高至 100 万 token ( 其后更新至 200 万 ) ,并初度收场了视频输入处明智商,为统统这个词行业创始了新的可能性。

紧随其后,Anthropic 于 3 月推出 Claude 3 系列,其中 Claude 3 Opus 连忙成为业界新标杆。6 月发布的 Claude 3.5 Sonnet 更是将性能推向新高度 , 即使在 10 月获取紧要升级后仍保持疏导版块号 ( 业内非负责称为 Claude 3.6 ) 。

2024 年最权贵的期间伊始是模子处理长文本智商的全面提高。只是一年前 , 大多数模子还局限于 4096 或 8192 个 token 的处明智商,唯独 Claude 2.1 例外地因循 20 万 token。而目下,险些统统主流提供商都因循 10 万以上 token 的处明智商。这一伊始极大拓展了 LLM 的应用范围——用户不仅不错输入整本册本进行内容分析,更挫折的是,在编程等专科领域,通过输入大批示例代码,模子粗略提供更准确的处置决议。

目下,超越 GPT-4 的阵营仍是相称强大。淌若你今天浏览 Chatbot Arena 排名榜,GPT-4-0314 仍是跌至第 70 位操纵。领有得分较高的模子的 18 个组织是:Google、OpenAI、阿里巴巴、Anthropic、Meta、Reka AI、01 AI、亚马逊、Cohere、DeepSeek、Nvidia、Mistral、NexusFlow、Zhipu AI、xAI、AI21 Labs、Princeton 和腾讯。

这种变化潜入地反应了 AI 领域的快速发展。在 2023 年,超越 GPT-4 照旧一个值得载入汗青的紧要突破,而到了 2024 年,这似乎仍是成为计算顶级 AI 模子的基本门槛。

部分GPT-4 级模子收场个东说念主电脑土产货运行

2024 年,大语言模子领域迎来另一挫折突破:GPT-4 级别的模子已可在普通个东说念主电脑上运行。这突破了 " 高性能 AI 模子必须依赖崇高数据中心 " 的传统明白。

以 64GB 内存的 M2 MacBook Pro 为例,统一台 2023 年仅能拼集运行 GPT-3 级模子的拓荒,目下已能运行多个 GPT-4 级模子,包括开源的 Qwen2.5-Coder-32B 和 Meta's Llama 3.3 70B。

这一突破令东说念主骇怪 , 因为此前运行 GPT-4 级模子被认为需要一台数据中心级做事器,配备一个或多个价值 40000 好意思元以上的 GPU。

更引东说念主注计算是 Meta 的 Llama 3.2 系列。其 1B 和 3B 版块虽不足 GPT-4, 但性能远超模子鸿沟预期。用户以致可通过 MLC Chat iOS 应用在 iPhone 上运行 Llama 3.2 3B, 这个仅需 2GB 存储空间的模子就能以每秒 20 个 token 的速率生成内容。

它们粗略运行的事实讲明了,许多模子在曩昔一年中取得了令东说念主难以置信的历练和推感性能提高。

由于竞争和效率提高,模子价钱暴跌

曩昔 12 个月里,大模子的价钱出现了急剧下降。

2023 年 12 月,OpenAI 对 GPT-4 收取 30 好意思元 / 百万输入 tokens 的用度。如今,30 好意思元 /mTok 的价钱不错让你获取 OpenAI 最崇高的模子 o1。GPT-4o 的价钱为 2.50 好意思元(比 GPT-4 低廉 12 倍),GPT-4o mini 的价钱为 0.15 好意思元 /mTok ——比 GPT-3.5 低廉近 7 倍,而且功能刚劲得多。

其他模子供应商收费更低。Anthropic 的 Claude 3 Haiku(3 月份推出,但仍是其最低廉的型号)价钱为 0.25 好意思元 /mTok。谷歌的 Gemini 1.5 Flash 价钱为 0.075 好意思元 /mTok,而他们的 Gemini 1.5 Flash 8B 价钱为 0.0375 好意思元 /mTok — 比前年的 GPT-3.5 Turbo 低廉 27 倍。

这些价钱下降是由两个要素鼓舞的:竞争加重和效率提高。

多模态 LLM 兴起

一年前,最引东说念主注计算例子是 GPT-4 Vision,它于 2023 年 11 月在 OpenAI 的 DevDay 上发布。谷歌的多多模态模子 Gemini 1.0 于 2023 年 12 月 7 日发布。

2024 年,险些每个挫折的模子供应商都发布了多模态模子。咱们在 3 月看到了 Anthropic 的 Claude 3 系列, 4 月看到了 Gemini 1.5 Pro (图像、音频和视频),然后 9 月带来了 Qwen2-VL 和 Mistral 的 Pixtral 12B 以及 Meta 的 Llama 3.2 11B 和 90B 视觉模子。咱们在 10 月获取了来自 OpenAI 的音频输入和输出,然后 11 月看到了 Hugging Face 的 SmolVLM ,12 月看到了来自 Amazon Nova 的图像和视频模子。

多模态是 LLM 的巨掀伊始,粗略针对图像(以及音频和视频)运行教导是应用这些模子的一种山外有山的新要领。

语音和及时视频开释假想力

开动出现的音频和及时视频模式值得特等说起。

与 ChatGPT 对话的智商于 2023 年 9 月初度收场,不外其时只是语音转文本模子和新的文本转语音模子的对接。

5 月 13 日发布的 GPT-4o 进行了一个全新语音模式的演示,该模子不错给与音频输入并输出听起来至极传神的语音,而无需单独的 TTS 或 STT 模子。

当 ChatGPT 高档语音模式终于推出时(从 8 月到 9 月逐渐推出),成果至极惊东说念主。OpenAI 并不是独逐个家领有多模态音频模子的团队。谷歌的 Gemini 也给与音频输入,而且 Google Gemini 应用设施目下不错以与 ChatGPT 访佛的样貌语言。亚马逊还预报了 Amazon Nova 的语音模式,但该模式将于 2025 年第一季度推出。

Google 于 9 月发布的 NotebookLM 将音频输出提高到了一个新水平,它不错让两个"播客操纵东说念主"就您输入到其用具中的任何内容进行令东说念主屁滚尿流的传神对话。

12 月份,及时视频成为新的焦点。ChatGPT 目下收场了与模子共享录像头,并及时接洽所看到的内容。Google Gemini 也展示了具有疏导功能的预览版块。

即时驱动的应用设施生成仍是是一种商品

2023 年的 GPT-4 就已收场这少许,但其提供的价值在 2024 年才泄漏出来。

大模子在编写代码方面至极出色,淌若你正确地给出一个教导,它们就不错使用 HTML、CSS 和 JavaScript 构建一个齐备的交互式应用设施。

当 Anthropic 发布 Claude Artifacts 时,他们鼎力鼓舞了这一想法,这是一项突破性的新功能。通过 Artifacts,Claude 不错为您编写一个按需交互式应用设施,然后让您径直在 Claude 界面内使用它。

从那时起,许多其他团队也建立了访佛的系统。GitHub 于 10 月发布了他们的版块 GitHub Spark。Mistral Chat 于 11 月将其添加为名为 Canvas 的功能。

这个教导驱动的自界说界面功能至极刚劲且易于构建,展望它将在 2025 年看成一项功能出目下宽泛的产物中。

最好模子的免费使用仅无间了短短几个月

本年短短几个月内,三款最好型号—— GPT-4o、Claude 3.5 Sonnet 和 Gemini 1.5 Pro ——均在全球大部分地区免费提供。

OpenAI 于 5 月向统统用户免费提供 GPT-4o ,而 Claude 3.5 Sonnet 自 6 月发布以来也免费提供。这是一个紧要变化,因为在曩昔的一年里,免用度户大多只可使用 GPT-3.5 级别的模子。

跟着 OpenAI 推出 ChatGPT Pro,阿谁时期似乎仍是完结,而且可能永恒完结了。这项每月 200 好意思元的订阅做事是打听其功能最刚劲的模子 o1 Pro 的独一道路。

由于 o1 系列(以终点他的畴昔模子)背后的技巧是耗尽更多的盘算时辰来获取更好的完结,我认为免费使用最好可用模子的日子不太可能再转头。

" Agent " 还莫得真实出现

" Agent "一词至极令东说念主懊恼,因为它艰苦单一、明确且宽泛知晓的含义。淌若你告诉我你正在构建" Agent ",那么你险些莫得向我传达任何信息。

我看到的" Agent "的两个主要类别是:一种认为 AI 智能体是那些代表你行动的东西——访佛旅行 Agent 的模子;另一种则认为 AI 智能体是粗略打听用具并通过这些用具在处置问题过程中轮回运行的大语言模子(LLM)。此外,"自治"这个术语也常常被加入进来,但相通莫得给出明确的界说。

岂论该术语的含义如何,Agent 仍然有那种永恒"行将到来"的嗅觉。抛开术语不谈,我仍然对 Agent 的实用性持怀疑魄力。

评估确切很挫折

2024 年,有少许变得至极昭着:为 LLM 驱动的系统编写考究的自动化评估是在这些模子之上构建有用应用设施最需要的妙技。

淌若您领有刚劲的评估套件,您就不错更快地采纳新模子,更好地进行迭代,并构建比竞争敌手更可靠、更有用的产物功能。

每个东说念主都知说念评估很挫折,但仍然艰苦对于如何最好地膨大它们的考究率领。

Apple Intelligence 很灾祸,Apple 的 MLX 库很棒

看成 Mac 用户,前年我认为短缺一台配备 NVIDIA GPU 的 Linux/Windows 机器,这对尝试新模子来说是一个巨大的劣势。2024 年就好多了。

在内容操作中,许多模子所以模子权重和库的体式发布的,这些库更偏向于因循 NVIDIA 的 CUDA,而不是其他平台。

在这方面,llama.cpp 生态系统提供了很大匡助,但真实的突破是苹果的 MLX 库,"一个为 Apple Silicon 遐想的数组框架"。它至极棒。

苹果的 mlx-lm Python 因循在我的 Mac 上运行多种 MLX 兼容模子,性能出色。Hugging Face 上的 mlx-community 提供了越过 1,000 个仍是调换为所需样子的模子。

固然 MLX 是一个游戏限定改变者,但苹果自家的" Apple Intelligence "功能大多令东说念主失望。Apple 的 LLM 功能只是对前沿 LLM 功能的板滞师法。

"推理"模子的兴起

2024 年临了一个季度最真义的发展是新的推理模子的出现。以 OpenAI 的 o1 模子为例——最初于 9 月 12 日看成 o1-preview 和 o1-mini 发布。

推理模子最大的立异是它开辟了一种扩展模子的新要领:模子不再只是通过在历练时加多盘算来提高模子性能,而是不错通过在推理上参加更多的盘算来处置更难的问题。

o1 的续集 o3 于 12 月 20 日发布,并在 ARC-AGI 基准测试中取得了令东说念主印象潜入的完结,可是资本也不低,展望总的盘算时辰用度资本越过 100 万好意思元。o3 展望将于 2025 年 1 月负责绽放使用。

OpenAI 并不是独逐个家参与该类别的公司。谷歌于 12 月 19 日发布了该类别的首款参赛者 gemini-2.0-flash-thinking-exp。阿里巴巴 Qwen 团队于 11 月 28 日发布了他们的 QwQ 模子;DeepSeek 于 11 月 20 日通过其聊天界面绽放了 DeepSeek-R1-Lite-Preview 模子供试用。Anthropic 和 Meta 尚未有任何进展,可是它们一定会跟进。

中国最好的 LLM 历练资本低于 600 万好意思元?

2024 年年底的紧要新闻是 DeepSeek v3 的发布。DeepSeek v3 是一个巨大的 685B 参数模子,部分基准测试将其阐发与 Claude 3.5 Sonnet 比肩。

Vibe 基准测试目下将其排在第 7 位,仅次于 Gemini 2.0 和 OpenAI 4o/o1 模子。这是迄今为止排名最高的开源许可模子。

DeepSeek v3 真实令东说念主印象潜入的是历练资本。该模子在 2788000 个 H800 GPU 小时上进行历练,算计资本为 5576000 好意思元。Llama 3.1 405B 历练了 30,840,000 个 GPU 小时——是 DeepSeek v3 所用时辰的 11 倍,但基准测试完结略差。

环境影响有所改善

模子(托管模子和在土产货运行的模子)效率的提高带来了一个可喜的完结是,在曩昔几年中,运行教导词的动力使用量和环境影响已大幅下降。

可是在历练和运行模子的基础设施成立仍然靠近着巨大的竞争压力。谷歌、Meta、微软和亚马逊等公司都参加了数十亿好意思元成立新数据中心,这对电网和环境产生了至极紧要的影响,以致有东说念主评述成立新核电站。

这种基础设施是必要的吗?DeepSeek v3 的 600 万好意思元历练用度和大模子价钱的无间下降可能暗意它不是必要的。

合成历练数据成果很好

目卑劣行一种说法,跟着互联网充斥着东说念主工智能生成的垃圾,模子自己将会退化,以我方的输出为食,最终导致其不能幸免的沦一火。

但这昭着不会发生。违反,咱们看到东说念主工智能实验室越来越多地使用合成内容进行历练——专门创建东说念主工数据来匡助率领他们的模子朝着正确的宗旨发展。合成数据看成预历练的挫折构成部分正变得越来越浩繁。

另一种常用技巧是使用较大的模子来匡助为较小、更低廉的替代决议创建历练数据——越来越多的实验室使用这种要领。DeepSeek v3 使用了 DeepSeek-R1 创建的"推理"数据。

用心遐想用于 LLM 的历练数据似乎是创建这些模子的一起。从网络上抓取齐备数据并松懈将其参加历练运行的日子仍是室迩人远了。

大模子越来越难使用

我一直在强调的一个不雅点是,LLM 是面向高档用户的用具。它们看起来很简略——向聊天机器东说念主输入音信能有多难呢?——但内容上,要充分专揽它们并幸免它们的各样罗网,你需要领有深厚的知晓力和申饬。

淌若说有什么问题变得更糟,那等于在 2024 年,这个问题变得愈加严重了。

咱们仍是构建了不错用东说念主类语言进行对话的盘算机系统,它们不错回应你的问题,况兼频繁粗略回应正确!... 但这要看问题的类型,发问的样貌,以及问题是否准确地体目下那些未公开的、玄机的历练数据聚会。

默许的 LLM 聊天界面就像是把完全莫得电脑申饬的新用户丢进 Linux 结尾,让他们我方摸索着去弄明白。与此同期,结尾用户对这些用具的知晓模子也越来越不准确,且充满误会。

许多信息更全面的东说念主仍是完全毁掉了 LLM,因为他们看不出任何东说念主能从如斯多弱势的用具中获益。想要从 LLM 中获取最大价值的关节妙技,等于学会如何使用那些既不能靠又极为刚劲的期间。掌执这一妙技昭着并诬害易。

学问散布极其不均

目下大多数东说念主都传奇过 ChatGPT,联系词有若干东说念主传奇过 Claude 呢?那些积极关注这些期间的东说念主与 99% 不缓和的东说念主之间的学问差距巨大。

变化的速率也并莫得匡助缓解这个问题。仅在曩昔一个月里,咱们就见证了直播接口的普及,你不错用手机录像头瞄准某个物体,用语音与它对话……。大多数自认为是极客的东说念主以致还没尝试过这个功能。

酌量到这项期间对社会的无间(以及潜在)影响,我认为这种差距的大小是不健康的。我但愿能有更多的奋力参加到改善这少许上。

LLM 需要更好的品评

许多东说念主对大模子期间感到终点反感。在一些公开论坛上,只是提议" LLM 是有用的"这个不雅点,就足以激勉一场大争论。

有许多旨趣让东说念主不可爱这项期间——环境影响、历练数据的(艰苦)伦感性、可靠性不足、负面应用,以及对东说念主们责任可能产生的负面影响。

LLM 皆备值得品评。咱们需要接洽这些问题,寻找缓解要领,并匡助东说念主们学习如何负包袱地使用这些用具,使其正面应用越过负面影响。

原文纠合:https://simonwillison.net/2024/Dec/31/llms-in-2024/万博manbext体育官网